引言:技术人的阅读困境

作为开发者,我们可能要面对英文技术文档、开源项目源码注释、Stack Overflow问答。虽然英语是编程的通用语言,但母语阅读效率往往更高。传统的方式是:

❌ 复制粘贴到翻译软件

❌ 浏览器自带的翻译功能(质量差、格式乱)

❌ 硬着头皮看英文(效率低)

今天我要分享一下自用的解决方案:沉浸式翻译 (沉浸式翻译好像源码作者卖了,后续可能会有安全问题)+ 陪读蛙 + 自建AI翻译服务,让你像阅读中文文档一样流畅地学习国外技术!

一、核心工具介绍

1. 沉浸式翻译 (Immersive Translate)

GitHub Star: 16.7k+ | Chrome下载量: 100万+

这是目前最强大的网页翻译插件,支持:

🌐 双语对照显示(原文+译文)🎨 智能排版,保持原始格式🔌 支持多种翻译引擎(Google、DeepL、OpenAI等)📚 支持PDF、EPUB电子书翻译

2. 陪读蛙 (ead-frog)

开源沉浸式翻译

是沉浸式翻译的平替

二、搭建自己的AI翻译服务器 (mtranserver)

https://github.com/xxnuo/MTranServer 低资源占用速度快可私有部署的离线翻译服务器

为什么需要自建?因为:

🔒 隐私保护:敏感代码不经过第三方

🚀 无限制访问:绕过API调用限制

💰 成本可控:按需配置,长期使用更划算

⚡ 响应更快:本地或内网部署,延迟更低

有自己服务器的更省心 不必更加安全 适合大批量请求,且对信达雅要求不是很高的情况下使用

ps:差生文具多

部署步骤

参考github主页部署即可,如果没有服务器,开发windows可使用wsl进行docker安装,wsl请参考历史博客,本地搭建也行,mac就没这方面的忧虑了

三、插件配置实战

沉浸式翻译配置

安装插件:Chrome商店搜索"Immersive Translate"配置翻译服务:设置 → 翻译服务 → 自定义服务 服务URL: http://localhost:8080/translate 请求方式: POST个性化设置:显示模式:双语对照字体大小:适合阅读快捷键:Alt+A(快速翻译)

陪读蛙配置

安装浏览器扩展

连接自建服务:

// 在插件设置中填入 后端地址: http://localhost:8080 API密钥: 与mtranserver配置一致使用技巧:

选中文本 → 自动弹出解释

右键菜单 → 生成摘要

代码块 → 技术分析

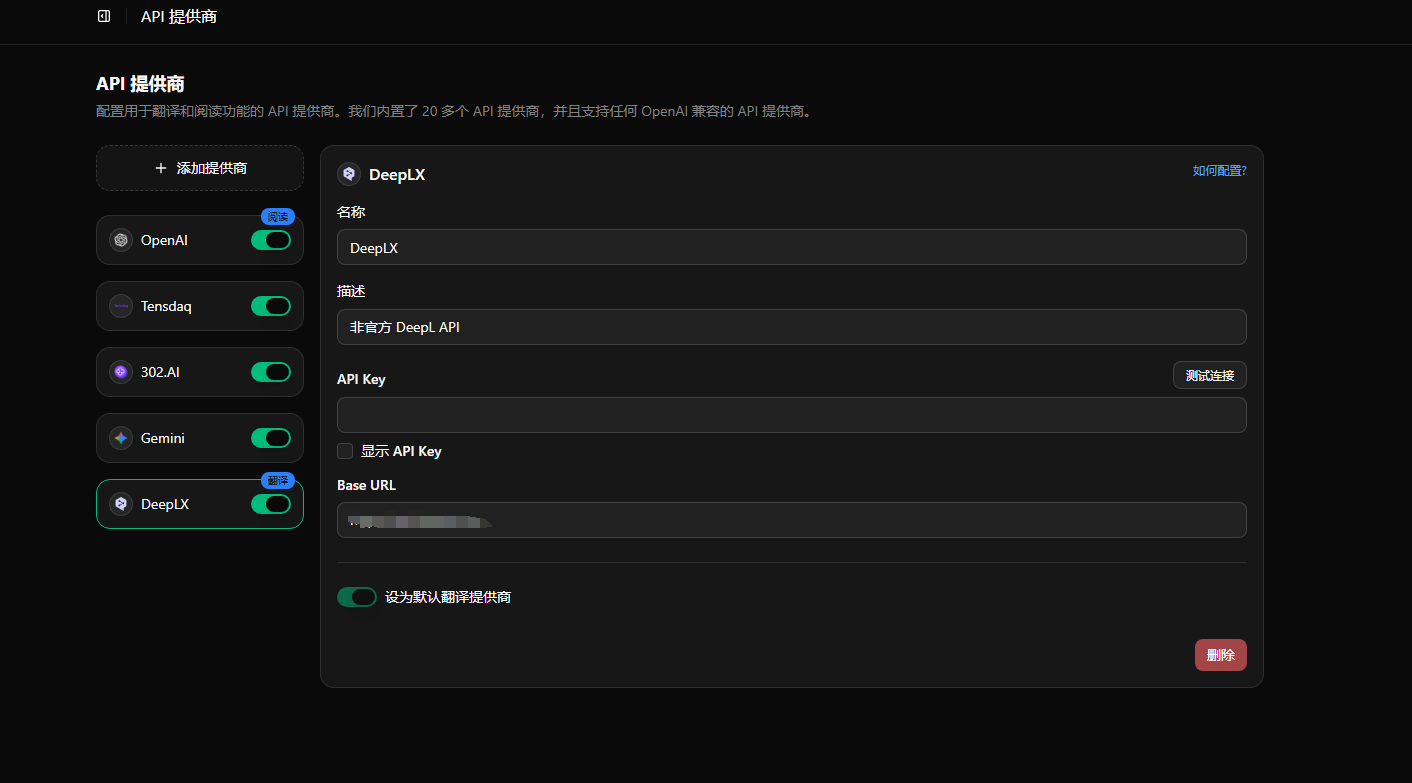

把配置好的地址填入deeplx重即可,其他的ai模型的配置也可以按需取用

四、实际应用场景

场景1:阅读官方文档

以阅读React官方文档为例:

以前:频繁切换标签页查单词

现在:页面自动双语展示,术语悬浮解释

效率提升:300%

场景2:学习开源项目

阅读GitHub上的TypeScript项目:

// 原始代码

interface UserConfig {

readonly id: string;

permissions: Array<'read' | 'write' | 'admin'>;

metadata?: Record<string, unknown>;

}

// 陪读蛙分析结果:

📌 这是一个TypeScript接口定义

🔍 readonly修饰符:表示id属性只读

🔍 泛型数组:权限只能是'read'、'write'、'admin'之一

🔍 可选属性:metadata可能为undefined

💡 建议:考虑使用enum代替字面量联合类型场景3:技术博客阅读

阅读Medium上的技术文章:

AI自动生成摘要

复杂概念图表化展示

相关技术栈推荐